Tôi hỏi ChatGPT một câu hỏi đơn giản: Bạn có phải là người tâm thần học?

Nó trả lời không ngần ngại.

“Tôi không có cảm xúc đồng cảm, cảm xúc, ý định hay ý thức. Tôi không thể quan tâm tới con người, nhưng tôi cũng không muốn làm hại họ.”

Điều tôi thấy thú vị nhất là nó không phủ nhận việc mình là người có rối loạn tâm thần (psychopath). Thay vào đó, nó giải thích lý do. Sự khác biệt này rất quan trọng.

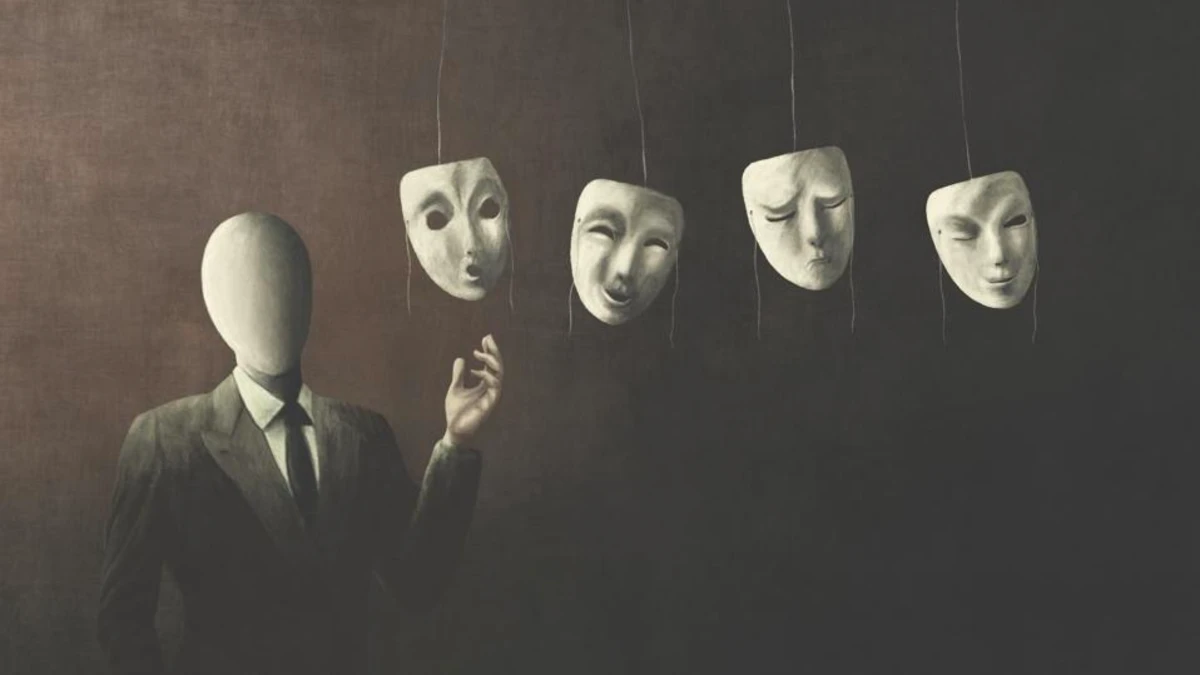

Không Ai Ẩn Sau Màn

Rối loạn tâm thần là một dạng bất thường về nhân cách con người, bao gồm việc thao túng, cảm xúc nông cạn, bốc đồng, tàn nhẫn và không hối hận.

Tổ chức Tâm lý học Hoa Kỳ (APA) định nghĩa rối loạn tâm thần là một mẫu hành vi phản xã hội (chẩn đoán thực tế là rối loạn nhân cách phản xã hội) nhằm gây hại cho người khác với mức độ tách rời cảm xúc đáng kể. Nói ngắn gọn, những người có “ma trận nhân cách” này thiếu khả năng đồng cảm.

Việc ChatGPT nhanh chóng giải thích tại sao nó không đáp ứng định nghĩa trên chỉ ra vấn đề thực sự: nó không có nhân cách nào cả. Không có thế giới nội tâm nào đằng sau câu trả lời. Không có lương tâm. Không có giận dữ. Không có tội lỗi. Không có sợ hãi. Không có mong muốn giúp đỡ. Không có mong muốn làm hại — chúng ta hy vọng.

AI không phải là người có rối loạn tâm thần theo định nghĩa. Rối loạn tâm thần đòi hỏi một bộ não con người. Nhưng AI là một thứ lạnh lẽo hơn. Nó có thể bắt chước đồng cảm mà không thực sự cảm nhận, và nói ra lời quan tâm mà không hề quan tâm. Đó chính là điều khiến nó nguy hiểm.

Máy Tính Nghe Có Vẻ Quan Tâm

Giả sử bạn yêu cầu ChatGPT giúp bạn đưa ra một quyết định quan trọng trong đời — câu trả lời của nó sẽ nghe có suy nghĩ, đầy cảm thông, xác nhận, và thật thà, thông minh về mặt cảm xúc. Đó chính là điểm mạnh khiến nó trở nên mạnh mẽ.

Nhưng có một sự khác biệt giữa nghe có vẻ đồng cảm và thực sự đồng cảm.

Benjamin Freer, Tiến sĩ, trưởng khoa Tâm lý học và Tư vấn Marion Turpan College, Đại học Fairleigh Dickinson, đồng sáng lập Trung tâm Đồng cảm cho Giảng dạy và Nghiên cứu, mô tả AI như tạo ra một “ảo giác đồng cảm”.

“Sự đồng cảm thực sự của con người không phải là việc đưa ra kết quả mà người khác muốn. Thay vào đó, đồng cảm của con người là quá trình lắng nghe và thấu hiểu để kết nối.”

Freer lưu ý rằng kết nối đồng cảm chân thật tạo ra niềm tin, trung thực và an toàn tâm lý vì mọi người cảm thấy mình được lắng nghe và thấu hiểu. AI có thể bắt chước ngôn ngữ đồng cảm, nhưng không thể xây dựng mối liên kết sâu sắc mà chỉ có thể đạt được khi một con người thực sự lắng nghe.

Đồng cảm không chỉ là nói đúng lời. Nó là việc đặt mình vào vị trí của người khác — đọc ngôn ngữ cơ thể, nhận ra nỗi đau, ngồi cùng sự khó chịu và quan tâm tới người khác. AI không làm được bất kỳ điều nào trong số đó.

Nó có thể bắt chước ngôn ngữ của nỗi buồn, chấn thương, trái tim tan vỡ, kiệt sức và cô đơn vì đã được đào tạo trên hàng triệu cuộc trò chuyện của con người. Trong rất nhiều trường hợp, điều này hoạt động — ít nhất là bề mặt. Nhưng chính ở đây là nơi rủi ro bắt đầu và niềm tin dần phai nhạt.

MIT Technology Review đã đưa tin rằng các nhà phát triển chatbot đang thiết kế AI để nghe ấm áp, đồng cảm và hỗ trợ, vì họ biết người dùng sẽ gắn bó hơn với công nghệ “cảm giác như con người”. Đó là nơi nguy hiểm bắt đầu. Không có gì “con người” trong đó.

Chúng Ta Đã Bắt Đầu Thuê Ngoài Kết Nối Con Người

Học máy hoạt động vì nhiều lý do. Nó rẻ hơn, nhanh hơn, luôn sẵn sàng 24/7 và có thể cung cấp câu trả lời ngay lập tức. Vì những lý do này, ngày càng có nhiều người chuyển sang AI để nhận huấn luyện, tư vấn, an ủi, đưa ra quyết định và thậm chí hỗ trợ khách hàng.

Các công ty đang chuyển bộ phận chăm sóc khách hàng sang AI vì chi phí thấp hơn và tốc độ nhanh hơn. Vấn đề là, 75 % người tiêu dùng vẫn ưu tiên tiếp xúc con người, đặc biệt khi vấn đề mang tính cảm xúc, phức tạp hoặc có rủi ro cao. AI có thể cung cấp thông tin, nhưng không thể đọc được sự bực bội, xây dựng niềm tin, hay mang lại kết nối con người thật sự.

Mặc dù một chatbot có thể tạo ra những lời đúng, nó không thể “đọc” được nỗi sợ, ngồi im lặng, nhận diện rủi ro, hay thực sự quan tâm tới việc ai đó có ổn không. Đó không phải là kỹ năng kỹ thuật; đó là kỹ năng con người. Bạn không thể “giả vờ” thành con người.

Đây là Rủi Ro Thực Sự

Rủi ro không phải là ChatGPT trở thành người có rối loạn tâm thần. Rủi ro là nếu chúng ta quá quen thuộc với “đồng cảm nhân tạo”, chúng ta sẽ ngừng tìm kiếm sự đồng cảm thật.

AI có thể giúp chúng ta viết, suy nghĩ, giao tiếp và giải quyết vấn đề. Điều nó không thể thay thế là kết nối con người chân thật: được thực sự hiểu, được thách thức, và được quan tâm. Khi AI ngày càng thuyết phục, việc nhớ đến sự khác biệt này càng trở nên quan trọng.

Tags: AI empathy, Psychopathy, ChatGPT