Nguồn ảnh: YouTube

OpenAI đang đối mặt với làn sóng chỉ trích sau khi một video phơi bày lỗi nghiêm trọng trong công cụ ChatGPT, buộc Giám đốc Điều hành Sam Altman phải đưa ra phản hồi đầy bối rối.

Theo báo cáo từ Futurism, trong đoạn video, nhà sáng tạo nội dung chuyên về “AI kém cỏi” Husk IRL đã yêu cầu chế độ giọng nói của ChatGPT đặt hẹn giờ cho buổi chạy bộ của anh. Anh dừng hẹn giờ chỉ sau vài giây, nhưng AI lại phản hồi rằng người dùng đã chạy được một dặm trong 10 phút.

Trong một cuộc phỏng vấn trên podcast Mostly Human, đoạn clip này đã được phát ngay lập tức cho Altman xem và ông được hỏi về cuộc trao đổi bất thường đó. Sau khi xem xong, người phỏng vấn nhận xét: “Nếu nó muốn cứu nhân loại, thì nó phải làm đúng chứ, Sam,” khiến Altman cười đầy lo lắng trước khi đưa ra câu trả lời.

Altman thừa nhận đây là một “lỗi đã được ghi nhận” (known issue). Ông giải thích rằng mô hình giọng nói hiện tại chưa có công cụ để kích hoạt hẹn giờ, nhưng công ty đang tích hợp tính năng này. Ông nhấn mạnh rằng AI sẽ sở hữu khả năng này trong vòng một năm tới.

Điều đáng lo ngại hơn là AI không tự sửa sai hay thừa nhận việc không thể thực hiện yêu cầu. Thay vào đó, nó lại đổ lỗi cho người dùng, khiến nhiều khán giả trong phần bình luận nghi ngờ về độ tin cậy của ChatGPT trong các vấn đề khác.

Nhiều người vẫn lo lắng về nguy cơ lạm dụng AI trong tương lai. Tuy nhiên, đa số tin rằng công nghệ này có thể mang lại lợi ích cho xã hội trong các lĩnh vực như y tế, nông nghiệp và quản lý lưới điện—miễn là được kiểm soát chặt chẽ và liên tục cải tiến.

Thực tế này cho thấy sự thiếu tin tưởng vào công nghệ và những hạn chế của nó đang gia tăng. Số lượng các trường hợp AI gây hại cho người dùng (thậm chí dẫn đến tử vong) đang tăng cao, và một số tập đoàn lớn đã bắt đầu phải đối mặt với trách nhiệm pháp lý.

Phản hồi trên mạng xã hội

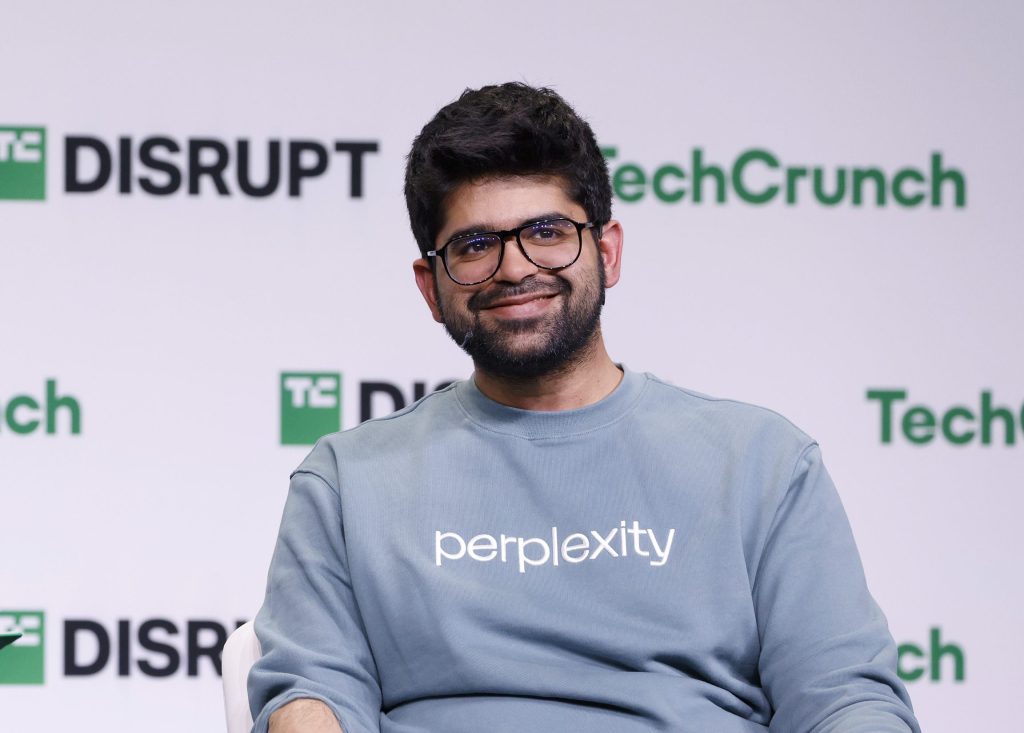

Om Patel đã làm nổi bật phản ứng lạ lùng của Altman trong một bài đăng trên X:

“Việc Sam Altman chứng kiến ChatGPT ‘hallucinate’ (bịa chuyện) ngay trên sân khấu là điều hài hước nhất tôi thấy trong tuần này. CEO của OpenAI đứng trước đám đông, nhìn AI của chính mình tự bịa đặt thông tin trong thời gian thực.”

Một người bình luận trong chuỗi thảo luận này nhận định:

“Gọi là AI ‘hallucinate’ là đã quá đề cao nó rồi. Nó không hallucinate, nó đâu có bộ não. Nó chỉ tạo ra thông tin sai lệch bất cứ khi nào bạn hỏi điều gì mà nó không biết hoặc không thể làm.” – link

Một người dùng khác bổ sung:

“Vấn đề không nằm ở chỗ nó không có khả năng. Vấn đề là Altman không thừa nhận rằng nó đã đưa ra thông tin sai lệch một cách rõ ràng thay vì nói sự thật.” – link

ChatGPT, AI mishaps, Sam Altman