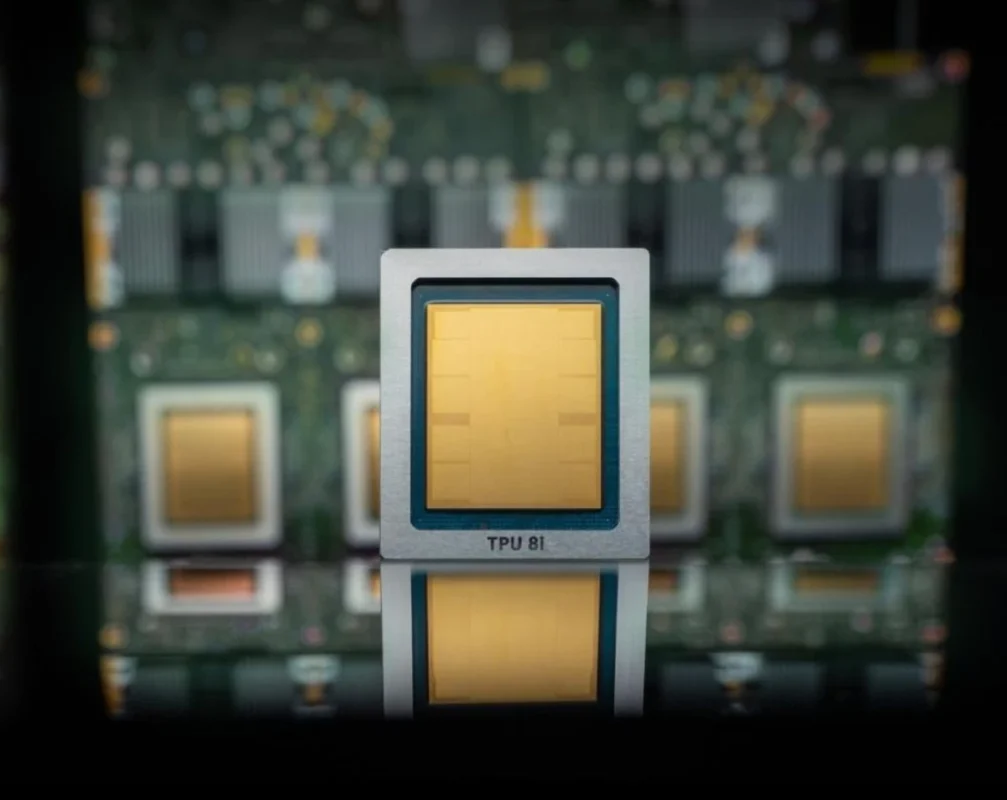

Thứ Tư vừa qua, Google Cloud đã công bố rằng thế hệ chip AI tùy chỉnh thứ tám, hay còn gọi là Đơn vị Xử lý Tensor (TPU), sẽ được chia thành hai phiên bản. Một chip mang tên TPU 8t sẽ tập trung vào việc huấn luyện mô hình, trong khi chip còn lại, TPU 8i, được thiết kế chuyên biệt cho quy trình inference (suy luận/triển khai mô hình).

Inference là quá trình vận hành mô hình liên tục, diễn ra ngay sau khi người dùng gửi yêu cầu.

Như dự đoán, Google đã đánh giá cao các thông số hiệu năng ấn tượng của dòng TPU mới so với các thế hệ trước: tốc độ huấn luyện mô hình AI nhanh gấp 3 lần, hiệu suất trên mỗi đô la tăng 80%, và khả năng kết nối hơn 1 triệu TPU trong một cụm duy nhất. Kết quả là mang lại năng lực tính toán vượt trội đồng thời giảm đáng kể chi phí năng lượng và chi phí cho khách hàng so với các phiên bản cũ. Sở dĩ các chip này được gọi là TPU chứ không phải GPU là vì chúng là chip tùy chỉnh tiêu thụ ít năng lượng, với tiền tố “Tensor” ngay từ tên gọi ban đầu.

Tuy nhiên, các chip của Google chưa phải là đòn tấn công trực diện nhằm vào tương lai của Nvidia, ít nhất là ở thời điểm hiện tại. Giống như các nhà cung cấp dịch vụ đám mây lớn khác, bao gồm Microsoft và Amazon, Google đang sử dụng những chip này để bổ trợ cho các hệ thống dựa trên Nvidia vốn đã có trong hạ tầng của mình, chứ không hoàn toàn thay thế Nvidia. Trên thực tế, Google cam kết sẽ cung cấp dòng chip mới nhất của Nvidia, Vera Rubin, trên nền tảng đám mây của họ vào cuối năm nay.

Trong tương lai, các nhà cung cấp dịch vụ đám mây quy mô siêu lớn đang tự phát triển chip AI (như Amazon, Microsoft và Google) có thể sẽ giảm sự phụ thuộc vào Nvidia khi các doanh nghiệp chuyển dịch nhu cầu AI lên đám mây và chuyển đổi (port) các ứng dụng để chạy trên những chip này.

Hiện tại, việc đặt cược vào thất bại của Nvidia vẫn chưa phải là một chiến lược sinh lời. Như nhà phân tích thị trường chip nổi tiếng Patrick Moore đã đùa nhẹ trên mạng xã hội X, ông từng dự đoán vào năm 2016 – khi Google ra mắt chip đầu tiên – rằng TPU của Google có thể là tin xấu đối với Nvidia (và Intel). Tuy nhiên, Nvidia hiện là một công ty có vốn hóa thị trường gần 5 nghìn tỷ USD, chứng tỏ dự đoán đó đã không trở thành hiện thực theo thời gian.

Nếu mọi thứ diễn ra đúng kế hoạch của Nvidia, thì sự tăng trưởng của Google với vai trò nhà cung cấp đám mây AI sẽ mang lại doanh thu cao hơn cho nhà sản xuất chip này chứ không hề giảm đi, ngay cả khi nhiều khối lượng công việc (workloads) được chạy trên chip của Google.

Trên thực tế, Google còn cho biết đã thỏa thuận hợp tác với Nvidia để thiết kế mạng lưới máy tính, giúp các hệ thống dựa trên Nvidia hoạt động hiệu quả hơn trên đám mây của mình. Cụ thể, hai gã khổng lồ công nghệ đang cùng nhau nâng cấp công nghệ mạng dựa trên phần mềm có tên là Falcon – một dự án do Google tạo ra và mã nguồn mở vào năm 2023 dưới sự bảo trợ của Open Compute Project, tổ chức hàng đầu về phần cứng trung tâm dữ liệu mã nguồn mở.

Tags: Google TPU, AI hardware, Cloud computing

](https://ainextvibe.com/wp-content/uploads/2026/01/005e39682c3b45e08bac3ebaf6e40396.jpg)