Chip LPU – Tác giả: Michael Kan

Để cải thiện hiệu năng của các chatbot, Nvidia dự định bán một loại bộ xử lý mới – LPU, được tối ưu để chạy các mô hình ngôn ngữ lớn (LLM). Chip Nvidia Groq 3 LPU nằm trong bảy chip sắp ra mắt mà Nvidia giới thiệu tại sự kiện GTC thường niên, nơi công ty thuyết phục ngành AI rằng các chip của mình vẫn dẫn đầu.

LPU, viết tắt của Language Processing Unit (Đơn vị Xử lý Ngôn ngữ), được giới thiệu trong thỏa thuận tháng 12 của Nvidia với công ty AI có trụ sở tại California – Groq. Groq, thành lập năm 2016, đã phát hành các chip LPU trước đây, thiết kế riêng cho LLM nhằm mang lại tốc độ nhanh hơn và tiêu thụ năng lượng thấp hơn. Mục tiêu là tạo ra một giải pháp thay thế cho các GPU doanh nghiệp của Nvidia, vốn có thể phục vụ một loạt các khối lượng công việc AI rộng hơn.

Hiện Nvidia muốn kết hợp “Groq 3 LPU” vừa công bố với các chip AI thế hệ mới khác của mình, dưới tên nền tảng “Vera Rubin”, bao gồm GPU Rubin sắp ra mắt và công nghệ CPU Vera dành cho trung tâm dữ liệu.

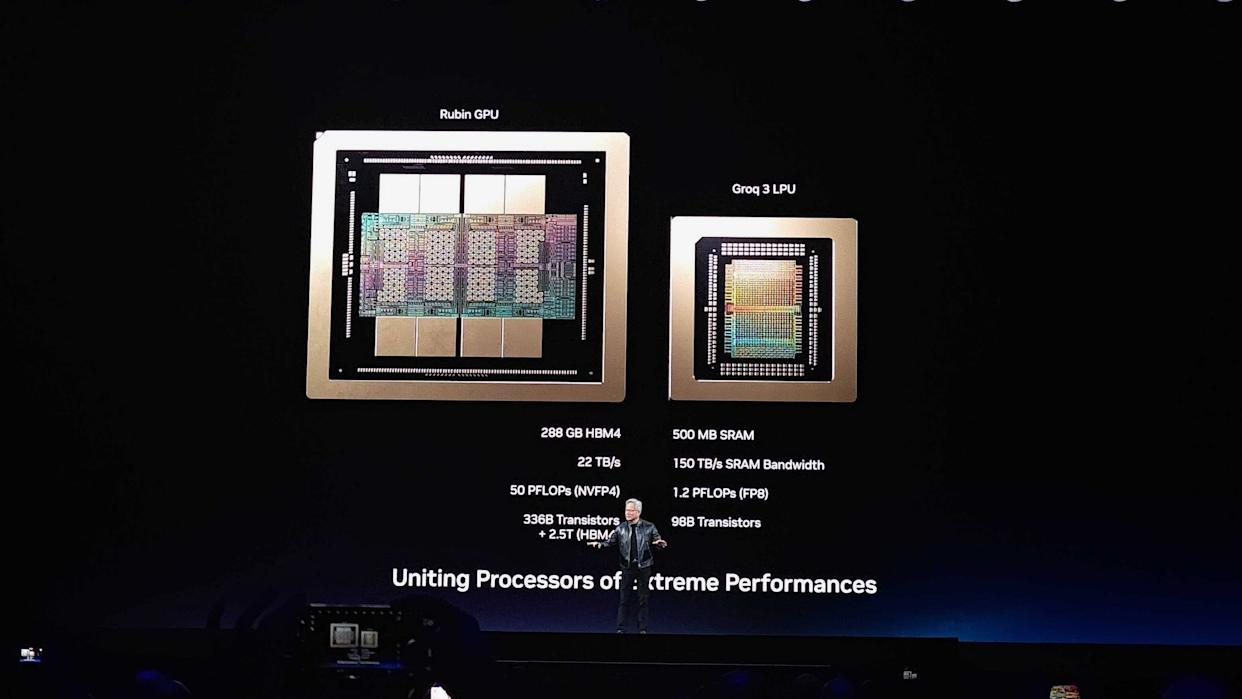

Các chip LPU của Groq sử dụng SRAM (bộ nhớ tĩnh) nhanh hơn đáng kể so với HBM (bộ nhớ băng thông cao) thường được gắn trên GPU của Nvidia. Tuy nhiên, SRAM của LPU chỉ cung cấp “vài trăm megabyte”, trong khi bộ nhớ HBM có thể lên tới hàng chục gigabyte trên một chip. Do đó, một Groq 3 LPU duy nhất chứa 500 MB SRAM, trong khi GPU Rubin sắp ra mắt sẽ sở hữu 288 GB HBM4. Để bù đắp cho dung lượng bộ nhớ hạn chế, Nvidia dự định bán số lượng lớn các LPU để chúng có thể hoạt động song song với các chip trung tâm dữ liệu, tạo điều kiện cho các công ty AI khai thác thêm hiệu năng.

Nvidia lưu ý: “kệ LPX với 256 bộ xử lý LPU cung cấp 128 GB SRAM trên mỗi LPU và băng thông lên tới 640 TB/s khi mở rộng. Khi được triển khai cùng Vera Rubin NVL72 (đơn vị máy chủ), các GPU Rubin và LPU sẽ tăng tốc độ giải mã bằng cách tính toán đồng thời mọi lớp của mô hình AI cho mỗi token đầu ra”.

Nhờ vậy, một trung tâm dữ liệu có thể khai thác đồng thời cả LPU và GPU của Nvidia, phân chia các khối lượng công việc AI giữa hai loại chip để nâng cao hiệu suất. Giám đốc điều hành Jensen Huang của Nvidia cho biết cách tiếp cận kết hợp này giúp các công ty AI đạt được hiệu năng tốt hơn ngay cả khi sử dụng các prompt (đầu vào) dài hơn.

Kết hợp LPU và GPU Rubin còn hứa hẹn tăng gấp tới 35 lần thông lượng khi chạy một mô hình ngôn ngữ lớn với 1 nghìn tỷ tham số, theo các số liệu dự báo của Nvidia.

“Chúng tôi đang trong giai đoạn sản xuất chip Groq,” ông Huang nói, đồng thời cho biết chip này có khả năng sẽ được giao trong quý III. Nvidia đã ký hợp đồng với Samsung để sản xuất LPU. Một nhà phân tích ước tính Nvidia sẽ xuất khẩu 4–5 triệu LPU tới năm 2026‑2027.

Chip LPU mới cùng hệ thống Vera Rubin dự kiến sẽ có giá hàng chục nghìn đô la Mỹ mỗi chiếc, khiến chúng xa vời với người tiêu dùng cá nhân. Thay vào đó, các công ty AI lớn – OpenAI, Anthropic, Meta và những tên tuổi khác – sẽ là những khách hàng chính, sử dụng công nghệ này để đáp ứng các đoạn hội thoại hoặc yêu cầu tạo ảnh trong tương lai gần.

Tại GTC, Nvidia cũng nhấn mạnh nền tảng Vera Rubin, một dự án họ đã đề cập trước đây, bao gồm cả trong CES tháng 1, khi công ty công bố các chip Rubin đã “được đưa vào sản xuất đầy đủ.” Nvidia dự định giao hàng các chip liên quan tới Vera Rubin, bao gồm LPU mới, vào nửa cuối năm nay.

Tags: Nvidia LPU, AI hardware, Vera Rubin