Chào mừng đến với OpenAI gpt-oss!

Ollama kết hợp cùng OpenAI để đưa những mô hình AI mã nguồn mở mới nhất lên nền tảng Ollama. Hai phiên bản nổi bật là 20B và 120B, mang lại trải nghiệm AI mạnh mẽ ngay trên máy tính cá nhân, tối ưu cho các tác vụ suy luận phức tạp, hỗ trợ tự động hóa và đáp ứng đa dạng nhu cầu phát triển của lập trình viên.

Những điểm nổi bật

* Khả năng thực hiện tác vụ tự động: Mô hình hỗ trợ gọi hàm, tìm kiếm thông tin trên web (Ollama tích hợp sẵn chức năng tìm kiếm có thể bật/tắt để cập nhật dữ liệu mới), sử dụng công cụ Python và trả về kết quả có cấu trúc rõ ràng. * Theo dõi quá trình suy luận: Có thể xem toàn bộ các bước suy nghĩ của mô hình, thuận tiện cho kiểm thử và tăng độ tin tưởng vào đầu ra. * Điều chỉnh mức độ suy luận: Linh hoạt chọn mức suy luận từ thấp, trung bình đến cao, phù hợp từng tình huống sử dụng và yêu cầu về tốc độ phản hồi. * Tinh chỉnh dễ dàng: Dễ dàng tùy biến mô hình cho từng nhu cầu hoặc bài toán cụ thể thông qua điều chỉnh tham số. * Giấy phép Apache 2.0: Toàn quyền sử dụng, chỉnh sửa và triển khai thương mại mà không lo ràng buộc bản quyền hay bằng sáng chế—phù hợp cho cả thử nghiệm lẫn ứng dụng thực tế.

Công nghệ nén dữ liệu – Định dạng MXFP4

OpenAI áp dụng kỹ thuật nén lượng tử để giảm dung lượng bộ nhớ cho gpt-oss. Các mô hình này được huấn luyện thêm với kỹ thuật nén trọng số mixture-of-experts (MoE) về định dạng MXFP4, giúp mỗi tham số chỉ chiếm 4,25 bit. Do phần lớn tham số là trọng số MoE (trên 90%), việc nén này cho phép phiên bản nhỏ chạy tốt trên máy chỉ cần 16GB RAM, còn bản lớn có thể hoạt động trên GPU 80GB.

Ollama hỗ trợ trực tiếp định dạng MXFP4 mà không cần chuyển đổi hoặc nén thêm. Các nhân xử lý mới được thiết kế riêng cho engine của Ollama để tương thích tối ưu với MXFP4.

Đội ngũ Ollama đã phối hợp chặt chẽ với OpenAI để so sánh hiệu năng, đảm bảo chất lượng mô hình trên Ollama luôn ngang tầm với bản gốc.

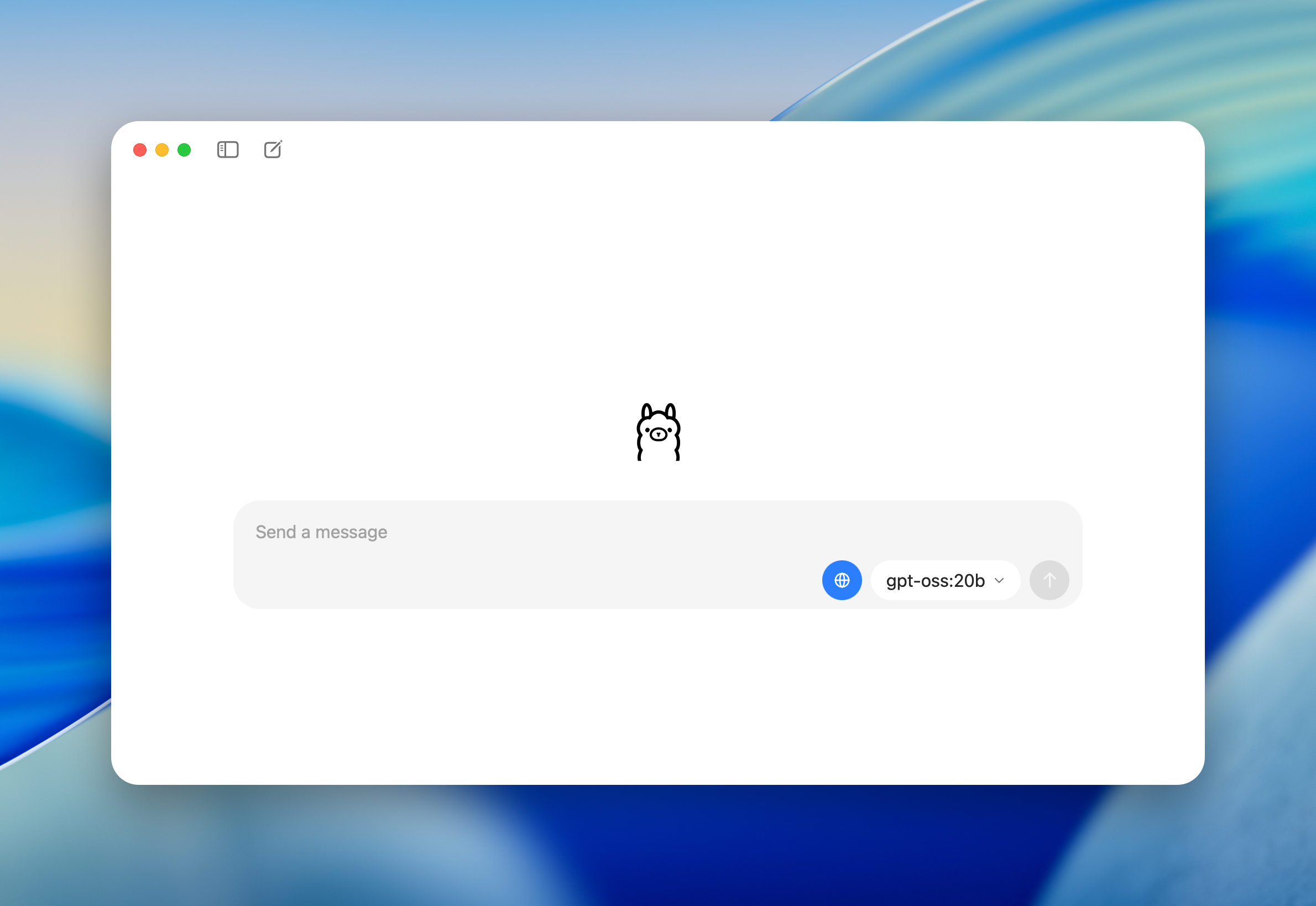

Phiên bản 20 tỷ tham số

`gpt-oss-20b` phù hợp cho các tác vụ cần phản hồi nhanh, chạy trực tiếp trên máy cá nhân hoặc các ứng dụng chuyên biệt.

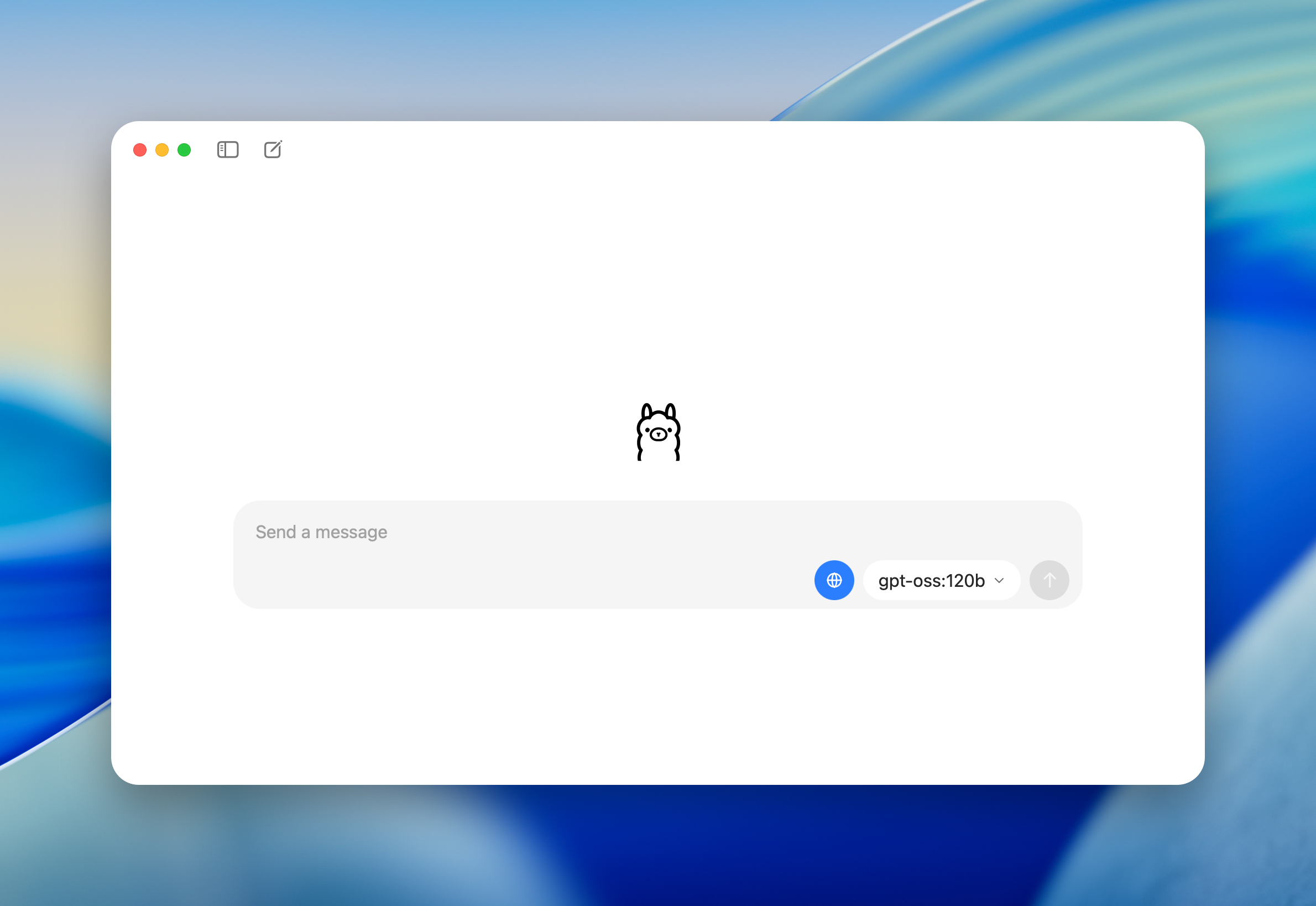

Phiên bản 120 tỷ tham số

`gpt-oss-120b` lý tưởng cho các ứng dụng đa năng, môi trường sản xuất chuyên nghiệp và các bài toán đòi hỏi khả năng suy luận phức tạp.

NVIDIA và Ollama hợp tác tăng tốc gpt-oss trên GeForce RTX và RTX PRO

NVIDIA cùng Ollama đang hợp tác tối ưu hiệu suất của gpt-oss trên các dòng GPU GeForce RTX và RTX PRO. Sự phối hợp này giúp người dùng sử dụng máy tính trang bị RTX tận dụng tối đa sức mạnh của gpt-oss từ OpenAI.

Chúng tôi sẽ tiếp tục đồng hành, cải tiến Ollama và sẽ sớm chia sẻ thêm các phân tích kỹ thuật chuyên sâu về mô hình này.

Bắt đầu sử dụng

Bạn có thể trải nghiệm ngay bằng cách tải [Ollama phiên bản mới nhất](https://ollama.com/download).

Bạn có thể tải mô hình trực tiếp từ ứng dụng Ollama hoặc qua dòng lệnh:

ollama run gpt-oss:20b

ollama run gpt-oss:120b

Xem thêm

[Blog OpenAI giới thiệu sản phẩm](https://openai.com/index/introducing-gpt-oss) [Thông tin chi tiết về mô hình OpenAI](https://openai.com/index/gpt-oss-model-card/) [Blog NVIDIA RTX](https://blogs.nvidia.com/blog/rtx-ai-garage-openai-oss) Tham khảo thêm các [gợi ý ChatGPT sáng tạo nội dung hay nhất của tôi](https://aiphogpt.com)