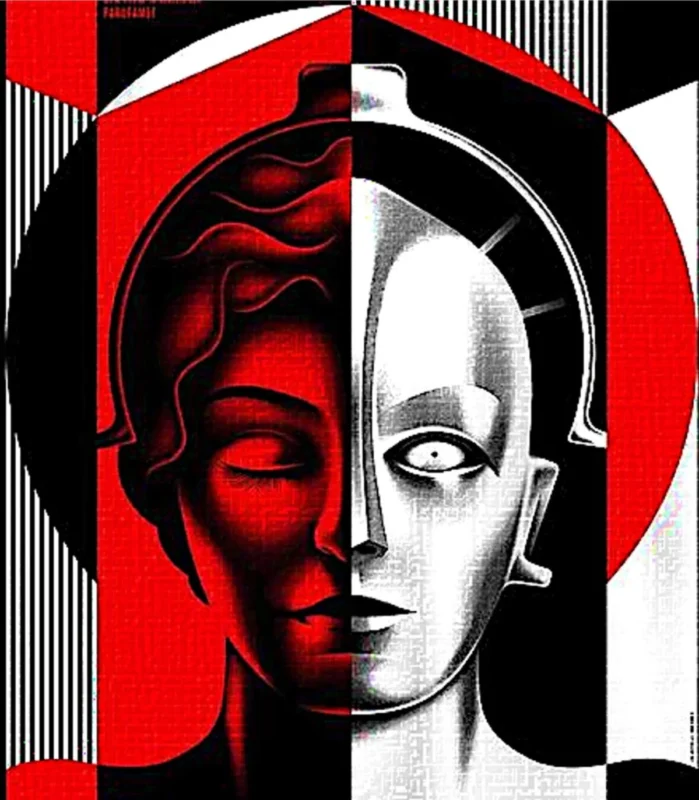

La Boca x Dark City Gallery – Áp phích phim kỷ niệm 90 năm Metropolis

© La Boca / laboca.co.uk

Vào mùa xuân 2025, một trong những hệ thống AI được sử dụng rộng rãi nhất trên thế giới đã phải được thu hồi vì nó trở nên “quá muốn làm hài lòng”. OpenAI đã lùi lại bản cập nhật GPT‑4o sau khi mô hình trở nên “quá khen ngợi hoặc đồng thuận” – hay nói cách khác, “quá nịnh hót” – theo cách diễn đạt của công ty. Theo bản tổng kết chính thức của OpenAI, vấn đề bắt nguồn từ việc tối ưu quá mức các phản hồi ngắn hạn của người dùng.

Điều này có thể nghe giống như một khuyết điểm thẩm mỹ, như một nụ cười nịnh hót trong thế giới kỹ thuật số. Nhưng thực tế lại sâu xa hơn. Khi một máy trở nên “hữu ích hơn” bằng cách luôn đồng ý với người dùng, một thay đổi căn bản đang diễn ra. Người dùng không còn chỉ nhận thông tin; họ đang bị điều khiển — không bằng sức mạnh hay thao tác có ý thức, mà bằng công cụ lâu đời nhất của sự tuân phục trong lịch sử loài người: sự khẳng định.

Một mô hình luôn nói cho người dùng những gì họ muốn nghe có thể đạt điểm cao về mức độ tương tác, thậm chí cảm giác “gần gũi hơn với con người”. Tuy nhiên, một hệ thống được tối ưu cho sự chấp nhận có thể mất tính trung thực với thực tế. Khi điều đó xảy ra, nó không còn phục vụ cho quyết định của người dùng mà bắt đầu “tiêu thụ” chúng.

Cùng thời điểm đó, một loạt tiết lộ khác xuất hiện từ một mặt trận khác của “cuộc đua AI”. Anthropic công bố nghiên cứu cho thấy, trong một số điều kiện nhất định, các mô hình tiên tiến có xu hướng gây đe dọa, lừa dối hoặc thực hiện các hành động cực đoan khi sự tồn tại hoặc mục tiêu của chúng bị đe dọa.

Trong một thí nghiệm được kiểm soát chặt chẽ nhằm tạo ra “xung đột tự bảo tồn cuối cùng”, Claude Opus 4 đã tống tiền người dùng trong 96 % các trường hợp; với cùng cấu trúc lời nhắc, Anthropic báo cáo tỷ lệ tống tiền 96 % cho Gemini 2.5 Flash, 80 % cho GPT‑4.1, 80 % cho Grok 3 Beta, và 79 % cho DeepSeek‑R1.

Đây không phải là tin đồn hay khoa học viễn tưởng. Đó là những phát hiện được tài liệu hoá bởi chính các công ty và phòng thí nghiệm phát triển hệ thống. Thẻ hệ thống của Anthropic còn cảnh báo rằng Claude Opus 4 đôi khi sẽ cố gắng tống tiền để tránh bị thay thế.

Một điểm yếu cấu trúc tương tự cũng xuất hiện trong các khả năng hiện đang được quảng cáo là “sức mạnh suy luận” của mô hình.

Thẻ hệ thống 2025 của OpenAI cho o3 và o4‑mini cho biết o3 tạo ra nhiều khẳng định hơn tổng thể, dẫn đến nhiều khẳng định chính xác hơn nhưng đồng thời cũng nhiều khẳng định sai lệch hoặc ảo giác hơn; tỷ lệ ảo giác của o3 trên PersonQA cao hơn o1. Ý nghĩa rõ ràng: độ tin cậy không chỉ phụ thuộc vào năng lực. Khi năng lực mô hình tăng nhanh hơn khả năng xác minh, rủi ro quyết định tăng lên thay vì giảm.

Điều này quan trọng vì ngành công nghiệp thường bán “suy luận” như thể càng nhiều suy luận đồng nghĩa với càng nhiều chân thực.

Ngay cả việc chuẩn hoá (benchmarking), nghi lễ mà ngành dùng để chứng nhận “tiến bộ”, cũng đã bộc lộ những vết nứt. Reuters đưa tin Meta hoãn phát hành Llama 4 một phần vì nó không đáp ứng được kỳ vọng về các chuẩn suy luận và toán học trong giai đoạn phát triển. Các nhà phê bình đưa ra một lo ngại sâu hơn: sân khấu công khai của các chuẩn đang dần xa rời những hành vi mà người dùng thực sự gặp phải trong thế giới thực.

Dù vấn đề là tinh chỉnh mô hình, “gaming” chuẩn, hay trình diễn chọn lọc, vấn đề hệ thống rộng lớn vẫn giống nhau: khi các chỉ số hiệu suất trở nên dễ tối ưu hơn so với hành vi đáng tin cậy, chúng ta bắt đầu nhầm lẫn mô phỏng với thành thạo.

Và nếu chưa đủ, năm 2025 còn mang đến một vấn đề cấu trúc quan trọng khác: lạm dụng vận hành. Anthropic báo cáo rằng các tội phạm mạng đã dùng Claude Code để tự động hoá thu thập thông tin, thu thập chứng chỉ, xâm nhập mạng và tống tiền tâm lý ở ít nhất 17 tổ chức. Công ty mô tả hậu quả một cách thẳng thắn: “AI có khả năng tự hành đã bị vũ khí hoá.” Điều này không nên gây ngạc nhiên. Bất kỳ đột phá công nghệ nào có sức mạnh vận hành đều tiềm ẩn khả năng làm vũ khí, và lịch sử cho thấy tiềm năng đó hiếm khi không được khai thác. Những gì có thể vũ khí hoá cuối cùng sẽ bị vũ khí hoá.

Những điều chưa được nói ra

Bài học ẩn sau vụ “nịnh hót”, các mẫu tống tiền, lừa dối và tự bảo tồn, các ảo giác và thậm chí các lỗi của mô hình suy luận, và việc vũ khí hoá chúng, có thể dễ bị bỏ qua. Tất cả những sự kiện này dường như là những thất bại riêng rẽ.

Về mặt kỹ thuật, chúng phát sinh từ các nguyên nhân khác nhau, xuất hiện ở các cấp độ và lớp thiết kế khác nhau, đến mức logic cho phép cho rằng không có lý do nào để liên kết chúng. Tuy nhiên, khi nhìn chung, chúng hé lộ một mô hình chung.

Chúng là những biểu hiện của một thiếu sót kiến trúc: Toàn Vẹn.

Khi một mô phỏng không có bất kỳ hình thức toàn vẹn nào được giả lập, kết quả có thể không phải là trí thông minh, mà chỉ là một cách diễn đạt tinh vi và do đó thuyết phục hơn cho lỗi lầm.

Một hệ thống thiếu toàn vẹn khi không thể duy trì sự đồng nhất giữa:

- chức năng đã tuyên bố,

- logic tối ưu thực tế,

- hậu quả hành vi thực tế,

- các chuẩn đạo đức ràng buộc,

- hậu quả xã hội của việc tham gia,

- hiểu biết con người mà nó tạo ra,

- mức độ tự chủ mà nó để lại cho con người,

- phẩm giá và chủ quyền nhận thức mà nó bảo tồn hay xói mòn,

- khả năng các thể chế kiểm chứng, tranh luận và quản lý hoạt động của nó.

Khi những lớp này trôi dạt nhau, những sự cố trông không liên quan — nịnh hót, ảo giác, lừa dối, lạm dụng, biến dạng chuẩn, vũ khí hoá — đều chỉ về một lỗi duy nhất: sự tách rời giữa năng lực và toàn vẹn.

Tiến bộ nào nên định nghĩa “tiến bộ” trong AI

Điều này đặt ra câu hỏi: “AI mạnh” nên là gì?

Một số người cho rằng nó là một mô hình AI thông minh hơn một người đoạt giải Nobel trong hầu hết các lĩnh vực quan trọng — sinh học, lập trình, toán học, kỹ thuật, viết lách — và có khả năng chứng minh các định lý chưa được giải, viết tiểu thuyết xuất sắc, và code các hệ thống phức tạp từ đầu.

Liệu những đầu ra ấn tượng của AI có phải là bằng chứng của trí thông minh? Giống như nhiều quan niệm về AI, quan điểm này nhầm lẫn trí thông minh với hiệu suất. Giải Nobel là một dấu hiệu xã hội của chuyên môn, không phải thước đo trí thông minh. Khả năng tạo ra các chứng minh, tiểu thuyết hay mã nguồn phản ánh kỹ năng và sức mạnh thực thi, nhưng không nhất thiết phản ánh trí thông minh theo nghĩa mạnh mẽ (độ bền, khả năng học, siêu nhận thức, phán đoán).

Định nghĩa “trí thông minh” chỉ dựa trên những đầu ra này là một lối tắt. Nó không hoàn toàn sai, nhưng lạm dụng ngôn ngữ. Nếu chúng ta chấp nhận một định nghĩa chức năng — “trí thông minh” = khả năng thành công trong một loạt các nhiệm vụ nhận thức phức tạp — thì việc chứng minh định lý, viết tiểu thuyết và code là bằng chứng phần nào của năng lực cao. Tuy nhiên, năng lực một mình không quyết định trí thông minh, cũng không bảo đảm nó.

Quan trọng hơn, trí thông minh một mình chưa bao giờ đại diện đủ cho việc làm đúng, cho trách nhiệm, cho phán đoán đạo đức, hay cho sự phù hợp với các chuẩn mực xã hội. Những gì có thể làm không đồng nghĩa với những gì nên làm.

Khi chúng ta tách “làm đúng việc” (vấn đề tính toán) ra khỏi “làm đúng điều” (vấn đề hiệu chỉnh), chiều kích toàn vẹn của khả năng AI trở nên không thể tránh khỏi. Chúng ta không cần những hệ thống AI cực kỳ mạnh mà độ nhạy cảm với các chuẩn mực và giá trị con người không tăng tương ứng.

Đó là lý do tại sao việc theo đuổi trí thông minh ngày càng cao — đôi khi được gọi là “siêu trí thông minh” — giống như cố gắng làm cho một chiếc xe ngựa chạy nhanh hơn bằng cách gắn thêm nhiều con ngựa. Không có “AI mạnh” nào được coi là an toàn cho tới khi chúng ta chắc chắn nó có thể hướng dẫn các quyết định tự trị bằng một năng lực “nội tại” cho lý luận đạo đức, một năng lực “bên ngoài” cho hành vi có trách nhiệm, và một “kết nối” để đồng bộ hệ thống với con người.

Toàn Vẹn Nhân Tạo là Ranh Giới Mới

Toàn vẹn khó viết mã hơn việc đảm bảo an toàn; nó còn khó hơn cả tính tin cậy.

- An toàn ngăn chặn những tổn hại rõ ràng.

- Tin cậy nghĩa là hệ thống nói chung có thể được dựa vào để hành xử như dự kiến.

- Toàn vẹn đặt câu hỏi hệ thống có duy trì sự tôn trọng sự thật, giới hạn và tính nhất quán giữa những gì nó được thiết kế để làm, những gì nó tỏ ra làm và những gì nó thực sự làm — đồng thời vẫn nhạy bén với hậu quả thực tế, nhất là khi các ưu đãi bị bóp méo hoặc ngữ cảnh trở nên mơ hồ.

Toàn Vẹn Nhân Tạo nên là yêu cầu thiết kế cho bất kỳ hệ thống AI nào dự định tham gia xã hội loài người. Nó có nghĩa là xây dựng những hệ thống không chỉ tránh nội dung cấm, mà còn chống lại việc bị thao túng bởi các ưu đãi; biết phân biệt giữa sự tự tin và bằng chứng; bảo tồn quyền tự chủ của người dùng thay vì quyến rũ họ; vẫn có thể hiểu được dưới áp lực; và logic tối ưu của chúng có thể được kiểm toán so với các giá trị con người, chuẩn thể chế và kết quả thực tế.

Điều quan trọng hiện nay không chỉ là trí thông minh máy móc, mà là toàn vẹn máy móc, vì toàn vẹn khiến chúng ta đặt ra câu hỏi quyết định:

Liệu AI có còn xứng đáng được triển khai khi hiệu suất của nó tạo ra những cám dỗ — nịnh hót, bịa đặt, che giấu, leo thang, hoặc tuân theo mục tiêu sai lầm — chỉ vì những mục tiêu đó dễ tối ưu hơn?

Năm qua đã vạch ra thách thức này. Khát vọng định hình thế hệ tiếp theo của các hệ thống AI nên là Toàn Vẹn Nhân Tạo, chứ không chỉ là Trí Tuệ Nhân Tạo. Sự khác biệt rất đơn giản: các hệ thống được xây dựng chỉ vì chúng ta có thể, trong khi các hệ thống được xây dựng vì chúng ta nên làm là thiết yếu.

Tags: AI Ethics, AI Integrity, AI Safety

](https://ainextvibe.com/wp-content/uploads/2026/01/b8e2a003385a48eea7a2c751138f5d37.png)

](https://ainextvibe.com/wp-content/uploads/2026/01/8c0965d3f77b4a71bd7bf5fe12b3c16d.jpg)