Các nhà sản xuất AI đang dần tăng cường các biện pháp bảo vệ sức khỏe tinh thần của con người, trong đó sử dụng “trusted contacts”.

AI và Sức khỏe tinh thần

Để đưa ra bối cảnh nhanh chóng, tôi đã theo dõi và phân tích rất nhiều khía cạnh liên quan đến thời đại AI hiện đại, nơi các công cụ AI cung cấp lời khuyên sức khỏe tinh thần và thực hiện liệu pháp dựa trên AI. Sự gia tăng sử dụng AI này phần lớn được thúc đẩy bởi những tiến bộ liên tục và việc áp dụng rộng rãi của generative AI. Để xem danh sách đầy đủ các phân tích của tôi, hãy tham khảo:

- Forbes author page

- Year‑long AI & mental‑health analyses (Jan 2026)

- Top trends & controversies (Apr 2024)

Tôi cũng đã thảo luận về những vấn đề này trong một tập của chương trình 60 Minutes của CBS – xem bản tin tại đây.

AI cung cấp hướng dẫn sức khỏe tinh thần

Hàng triệu người đang dùng generative AI như một người cố vấn liên tục về các vấn đề sức khỏe tinh thần. Riêng ChatGPT đã có hơn 900 triệu người dùng hoạt động hàng tuần, trong đó không ít người trò chuyện với mô hình về các chủ đề liên quan tới sức khỏe tinh thần. Xem các phân tích của tôi:

Việc tiếp cận 24/7 với chi phí thấp khiến AI trở thành một nguồn tài nguyên hấp dẫn cho sức khỏe tinh thần, nhưng đồng thời cũng làm dấy lên lo ngại về những lời khuyên không phù hợp hoặc thậm chí gây hại. Các LLM đa năng (ChatGPT, GPT‑5, Claude, Gemini, Grok, CoPilot,…) không thể thay thế cho các nhà trị liệu được đào tạo, trong khi các mô hình AI chuyên dụng cho sức khỏe tinh thần vẫn đang trong giai đoạn đầu. Tham khảo thêm:

Thiết lập liên hệ cá nhân cho các trường hợp khẩn cấp

Nhiều nền tảng generative AI đã có các tính năng kiểu “parental control” cho phép phụ huynh giám sát việc sử dụng AI của con. Việc mở rộng khái niệm “trusted contact” cho người lớn là hợp lý: người dùng có thể chỉ định trước một người bạn, thành viên gia đình hoặc đồng nghiệp sẽ nhận thông báo nếu AI phát hiện dấu hiệu lo âu nghiêm trọng.

Chi tiết quyết định mọi thứ

- Lựa chọn người liên hệ: Người dùng có thể chọn thành viên gia đình, bạn thân hoặc đồng nghiệp đáng tin. Người được chỉ định phải được thông báo và đồng ý nhận vai trò này.

- Cảnh báo dương tính giả: AI có thể gửi thông báo cho người liên hệ ngay cả khi người dùng thực tế không gặp vấn đề, gây lo lắng không cần thiết.

- Âm tính giả: Nếu thông báo bị trì hoãn, có thể bỏ lỡ thời điểm quan trọng khi người dùng thực sự cần giúp đỡ.

- Thay đổi người liên hệ: Khi một “trusted contact” không còn khả dụng (ví dụ: qua đời), hệ thống nên nhắc người dùng cập nhật danh sách.

Người hoài nghi vẫn chưa tin

Có ý kiến cho rằng người lớn nên tự quản lý việc tiếp cận sức khỏe tinh thần mà không cần cảnh báo do AI khởi xướng. Tuy nhiên, khi AI ngày càng lan tỏa, xã hội kỳ vọng có các biện pháp bảo vệ cho những người đang trải qua khủng hoảng tinh thần. Áp lực pháp lý đang tăng lên, với các vụ kiện cáo buộc thiếu giám sát AI.

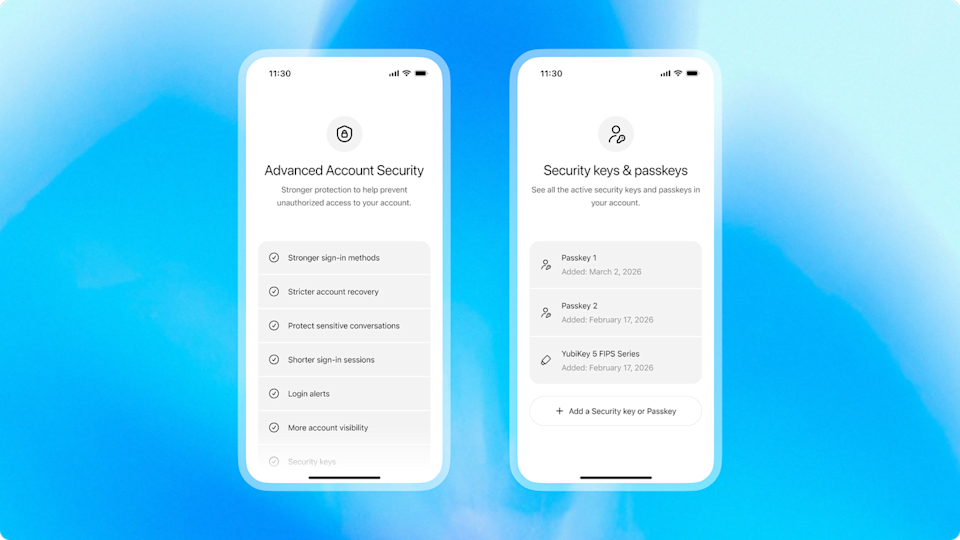

Tính năng Trusted Contact của OpenAI ChatGPT

OpenAI công bố tính năng “Trusted Contact” trong một bài blog mang tiêu đề “Introducing Trusted Contact in ChatGPT” (7 tháng 5 năm 2026). Các điểm chính:

- Tính năng an toàn tùy chọn: cho phép người lớn chỉ định một người đáng tin (bạn, thành viên gia đình, người chăm sóc) sẽ được thông báo nếu hệ thống phát hiện ngôn ngữ tự gây hại, cho thấy mối nguy hiểm nghiêm trọng.

- Dựa trên cơ chế cảnh báo parental‑control: đã có cho tài khoản thiếu niên.

- Kiểm duyệt con người: Mọi thông báo đều được một nhân viên được đào tạo xem xét trước khi gửi, với mục tiêu thời gian kiểm duyệt dưới một giờ.

- Thông tin hạn chế: Thông báo chỉ chứa lý do chung, không kèm bản ghi chép cuộc trò chuyện, nhằm bảo vệ quyền riêng tư của người dùng.

- Hệ quả pháp lý: Mục tiêu một giờ có thể trở thành điểm tranh cãi trong các vụ kiện tương lai.

Các rủi ro pháp lý tiềm ẩn

Mặc dù “trusted contacts” giúp giảm thiểu rủi ro, chúng không loại bỏ hoàn toàn trách nhiệm pháp lý. Các lập luận có thể xuất hiện từ nguyên đơn:

- Không bật tính năng: Người dùng chưa kích hoạt tính năng có thể cho rằng nhà sản xuất AI nên bắt buộc bật.

- Cảnh báo sai: Người dùng có thể khẳng định một cảnh báo không cần thiết đã gây phiền toái hoặc xâm phạm quyền riêng tư.

- Liên hệ lỗi thời: Nếu người được chỉ định không còn liên lạc được, nguyên đơn có thể cho rằng nhà sản xuất AI nên xác minh tính khả dụng của liên hệ.

Thế giới chúng ta đang sống

AI trong lĩnh vực sức khỏe tinh thần mang lại cả hứa hẹn và rủi ro. “Trusted contacts” chỉ là một lớp trong chiến lược an toàn rộng hơn, có thể sẽ trở thành yêu cầu bắt buộc hoặc vẫn duy trì ở mức tùy chọn. Các cuộc tranh luận pháp lý, đạo đức và quy định sẽ quyết định cách các tính năng này được triển khai và thực thi.

“The safety of the people shall be the highest law.” – Marcus Tullius Cicero

AI mental health, trusted contacts, OpenAI