Trong vài năm qua, AI hầu như luôn ở “xa” hoặc ít nhất là ẩn sau hậu trường. Chúng ta đặt câu hỏi cho ChatGPT, trong khi các trung tâm dữ liệu khổng lồ chứa đầy GPU thực hiện phần lớn công việc nặng nhọc mà không ai nhìn thấy.

Nhưng Nvidia, công ty cung cấp sức mạnh cho phần lớn cuộc cách mạng AI, dường như đang đặt cược vào một hướng đi hoàn toàn khác cho tương lai: một siêu máy tính AI ngay trong ngôi nhà của bạn.

Vậy thực sự đang xảy ra gì?

Credit: Future

Nvidia đang phát triển những gì họ gọi là “personal AI supercomputers” – những máy móc AI nhỏ gọn nhưng cực kỳ mạnh mẽ, được thiết kế để chạy các mô hình tiên tiến ngay tại chỗ thay vì hoàn toàn dựa vào đám mây.

Cụ thể, DGX Spark của Nvidia là một hệ thống AI cỡ bàn làm việc mà công ty mô tả là “AI supercomputer trên bàn của bạn”. Hệ thống này có khả năng chạy các mô hình AI lớn tại chỗ và hướng tới các nhà phát triển, nhà nghiên cứu cũng như các quy trình AI cao cấp.

Theo Nvidia, những thiết bị này đủ mạnh để thực hiện suy luận AI cục bộ, robot, các ứng dụng edge AI, các tác nhân tự động, thị giác máy tính và hệ thống thông minh — nói chung là AI hoạt động gần hơn với người dùng thay vì nằm trong hạ tầng đám mây xa xôi.

Tại sao ngành công nghiệp có thể đang hướng tới hướng này

Credit: Shutterstock

Hiện tại, hầu hết các công cụ AI phụ thuộc mạnh mẽ vào các nhà cung cấp đám mây khổng lồ. Điều này hoạt động, nhưng cũng tạo ra một số vấn đề lớn:

- AI tốn kém. Việc chạy các mô hình AI lớn tiêu tốn một khoản tiền và năng lượng khổng lồ. Các trung tâm dữ liệu đang mở rộng nhanh chóng, gây áp lực lên lưới điện toàn cầu. Phân phối một phần xử lý này sang các thiết bị cục bộ có thể giảm chi phí đám mây và giảm tải hạ tầng.

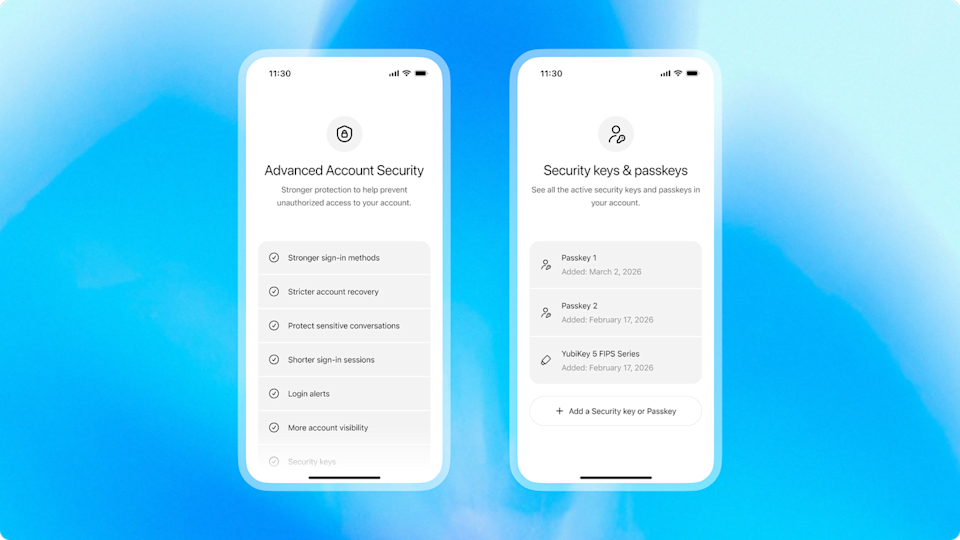

- Mối lo ngại về quyền riêng tư. AI cục bộ đồng nghĩa với việc ít dữ liệu được gửi tới máy chủ từ xa, mang lại quyền riêng tư tốt hơn và kiểm soát dữ liệu của bạn nhiều hơn.

- Tốc độ. AI trên đám mây gây độ trễ; AI cục bộ có thể cung cấp các trợ lý giọng nói tức thời, kính thông minh, robot gia đình, hệ thống an ninh và các công cụ offline với độ trễ thấp hơn đáng kể.

Ngôi nhà tương lai của bạn có thể lặng lẽ trở thành một trung tâm AI

Credit: Jelena Zelen/Shutterstock

Một báo cáo gần đây từ Inc. cho biết Nvidia đang hợp tác với startup Span để thử nghiệm các đơn vị “mini” trung tâm dữ liệu AI gắn vào nhà ở và doanh nghiệp nhỏ. Mục tiêu là khai thác công suất điện chưa sử dụng trong các hộ gia đình để hỗ trợ các khối lượng công việc AI.

Các đơn vị, được gọi là XFRA nodes, được thiết kế để đặt cạnh cơ sở hạ tầng hiện có trong nhà (hệ thống HVAC, bảng điện, v.v.). Thay vì phụ thuộc hoàn toàn vào các cơ sở tập trung quy mô lớn, sức mạnh tính toán sẽ được phân phối qua hàng ngàn địa điểm nhỏ hơn.

Lý do thực sự Nvidia đẩy mạnh DGX Spark và dòng RTX 50 không chỉ vì các chatbot nhanh hơn—mà là để hỗ trợ Autonomous AI Agents. Đến năm 2026, trọng tâm sẽ chuyển từ các trợ lý đơn giản sang các tác nhân có thể tự động quản lý lịch, tài chính và các chức năng nhà thông minh.

Để thực hiện điều này một cách an toàn, ngành công nghiệp đang chuyển sang Local Inference vì ba lý do then chốt:

- Tự động 24/7. Một tác nhân AI giám sát an ninh nhà hoặc quản lý tiêu thụ năng lượng phải luôn hoạt động ngay cả khi internet bị ngắt. Phần cứng cục bộ như Grace Blackwell superchip cho phép hoạt động liên tục mà không cần kết nối đám mây liên tục.

- Quyền riêng tư không để lại dấu vết. Gửi sao kê ngân hàng, email hay luồng camera lên đám mây là rủi ro bảo mật. Các công cụ như Nvidia OpenShell cho phép các tác nhân hoạt động trong một “sandbox riêng tư” ngay trong ngôi nhà của bạn, đảm bảo dữ liệu không bao giờ rời khỏi nhà.

- Trung tâm Digital Twin. Các hệ thống cao cấp như DGX Spark có thể chạy một “Digital Twin” của toàn bộ cuộc sống số của bạn, đóng vai trò như bộ não cục bộ cho điện thoại, kính thông minh, thiết bị gia dụng và hơn thế nữa—xử lý dữ liệu tại một địa điểm an toàn, tốc độ cao.

Kết luận

Nvidia có lẽ không mong người dùng sẽ lắp đặt hàng loạt rack GPU trong tầng hầm, nhưng các ngôi nhà có thể dần đầy các thiết bị hỗ trợ AI xử lý dữ liệu tại chỗ — một sự chuyển đổi lớn so với mô hình “đám mây trước” hiện nay.

Nvidia không đơn độc. Apple, Microsoft, Google và các hãng khác đang mạnh mẽ thúc đẩy các chiến lược “on‑device AI” và “edge AI”. Apple Intelligence nhấn mạnh việc xử lý riêng tư trên thiết bị; Microsoft đang nhúng AI trực tiếp vào các máy tính Windows; Qualcomm đang chạy đua để tạo ra các chip sẵn sàng cho AI trên laptop và điện thoại.

Cũng giống như PC gaming đã chuyển mình từ thiết bị dành cho người đam mê thành công nghệ gia đình phổ thông, phần cứng AI có thể sẽ đi theo con đường tương tự trong thập kỷ tới, di chuyển từ các trang trại máy chủ xa xôi tới lặng lẽ hiện diện trong phòng khách của chúng ta.

Nvidia, AI supercomputer, Edge AI

](https://ainextvibe.com/wp-content/uploads/2026/01/8c0965d3f77b4a71bd7bf5fe12b3c16d.jpg)